Articlé rédigé par Dr. Philippe Jacquet, Data Scientist, Division Calcul et Soutien à la Recherche (DCSR).

Avez-vous déjà voulu poser les mêmes questions à des milliers de documents, comparer plusieurs modèles d’IA, ou transformer une vaste collection de textes en données de recherche structurées ?

Ce sont précisément le type de tâches de recherche pour lesquelles DCSR-LLM a été développé à l’UNIL.

Qu’est-ce que la DCSR ?

La DCSR signifie Division Calcul et Soutien à la Recherche. Nous faisons partie du Centre Informatique de l’UNIL. Nous sommes une équipe d’environ 20 personnes. Notre rôle est d’aider la communauté de recherche de l’UNIL pour les besoins en calcul, en stockage de données et en support technique pour les projets de recherche.

Certains membres de l’équipe gèrent l’infrastructure de calcul utilisée à l’UNIL. D’autres travaillent directement avec les chercheuses et chercheurs et fournissent du conseil scientifique et technique.

Quel type de soutien la DCSR apporte-t-elle ?

La DCSR fournit deux grands types de soutien.

Le premier est l’infrastructure. Cela comprend les ordinateurs, l’espace de stockage et les systèmes techniques que les chercheuses et chercheurs peuvent utiliser pour des tâches de recherche exigeantes. Le second est l’expertise : le personnel de la DCSR accompagne les projets sur des sujets comme la programmation scientifique, le machine learning, les bases de données et le développement web.

La DCSR n’est donc pas seulement un lieu où se trouvent des machines. C’est aussi une unité de soutien composée de personnes qui aident les chercheuses et chercheurs à utiliser ces outils de manière utile.

Que sont les clusters HPC ?

Le terme HPC signifie High-Performance Computing, c’est-à-dire le calcul haute performance. Il désigne des systèmes de calcul puissants utilisés pour des tâches trop grandes, trop lentes ou trop exigeantes pour un ordinateur portable ordinaire. Un cluster HPC est un groupe d’ordinateurs qui travaillent ensemble. Au lieu de tout faire sur une seule machine, un cluster peut répartir le travail sur plusieurs machines.

À l’UNIL, il existe deux clusters HPC : Curnagl et Urblauna. Leurs noms sont dérivés de noms d’oiseaux en romanche. Ils sont utilisés pour des tâches de recherche exigeantes telles que les simulations, l’analyse de données, le machine learning et les workflows liés à l’IA.

Une manière simple de le comprendre est la suivante : si votre ordinateur portable suffit, vous utilisez votre ordinateur portable. Si votre travail devient trop lourd, trop lent ou demande plus de mémoire, alors le cluster devient utile.

Que sont les grands modèles de langage ?

Les grands modèles de langage, ou LLMs (Large Language Models), sont des systèmes d’IA entraînés sur de très grandes quantités de texte. Ils peuvent répondre à des questions, résumer des documents, reformuler du texte, classer de l’information ou extraire des faits à partir de documents écrits. La plupart des gens les connaissent à travers des outils comme ChatGPT, Claude ou Gemini.

Qu’est-ce que Hugging Face ?

Hugging Face est une plateforme sur laquelle les gens partagent des modèles d’IA et des jeux de données. Une comparaison simple serait de dire que c’est un peu comme GitHub, mais pour les modèles de machine learning et les données. Hugging Face fournit aussi des outils logiciels qui facilitent le téléchargement et l’exécution de modèles de langage open source sur un ordinateur ou un serveur.

Qu’est-ce que LM Studio ?

LM Studio est une application qui permet d’exécuter certains modèles de langage localement à travers une interface de chat. En pratique, cela ressemble un peu à l’utilisation de ChatGPT, sauf que le modèle peut tourner sur votre propre ordinateur. Cela peut être utile pour des expériences locales simples.

Pourquoi la DCSR a-t-elle créé DCSR-LLM ?

Parce que de nombreuses chercheuses et de nombreux chercheurs veulent utiliser l’IA, mais que leurs besoins vont souvent au-delà d’un simple chatbot.

Un chatbot est utile pour poser une question ou rédiger un paragraphe. Mais la recherche demande souvent quelque chose de plus structuré. Les chercheuses et chercheurs peuvent vouloir :

– tester plusieurs modèles sur une même tâche ;

– travailler sur une grande collection de documents ;

– garder les données sur l’infrastructure de l’UNIL ;

– enregistrer précisément les paramètres utilisés dans une analyse ;

– répéter le même workflow plus tard.

C’est pour cela que la DCSR a développé DCSR-LLM.

Qu’est-ce que DCSR-LLM ?

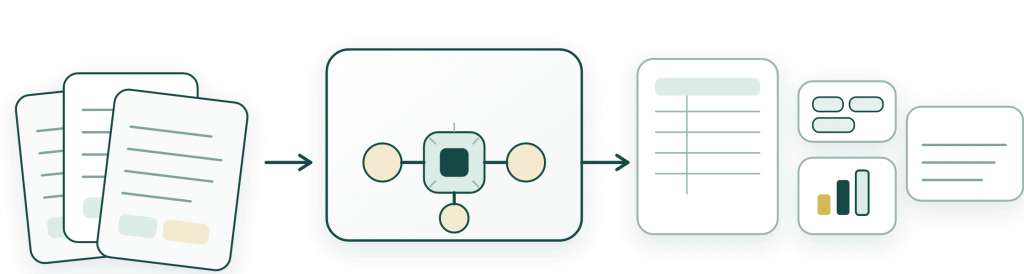

DCSR-LLM est une boîte à outils développée à l’UNIL pour travailler avec les grands modèles de langage de manière plus structurée.

Elle permet aux chercheuses et chercheurs d’utiliser des modèles open source depuis Hugging Face, de les exécuter localement ou sur les serveurs de l’UNIL, de les comparer, de les évaluer sur des tâches précises, d’extraire des informations structurées à partir de textes et d’adapter certains modèles à des usages plus spécialisés, et d’exporter des modèles au format GGUF pour une utilisation dans LM Studio.

Ce n’est pas seulement un chatbot. C’est un outil pensé pour des workflows de recherche.

Pourquoi ne pas simplement utiliser ChatGPT ou Claude ?

Pour de nombreux usages du quotidien, ChatGPT ou Claude sont très utiles. Mais dans la recherche, trois questions supplémentaires comptent souvent.

La première est : où vont les données ? Certains projets impliquent des données sensibles, non publiées ou internes. Dans ce cas, les chercheuses et chercheurs peuvent préférer un environnement plus contrôlé.

La deuxième est : quel modèle suis-je en train d’utiliser ? Les différents modèles se comportent différemment. En recherche, il est souvent utile de les comparer plutôt que de dépendre d’un seul assistant.

La troisième est : puis-je répéter clairement le même workflow ? Si un résultat produit par l’IA a de l’importance dans un projet, il est généralement nécessaire de documenter comment il a été obtenu.

DCSR-LLM est utile parce qu’il aide sur ces trois points.

Que signifie ici le terme « reproductible » ?

Cela signifie que le travail est réalisé d’une manière qui peut être répétée et documentée. Si vous utilisez le même modèle, les mêmes données et les mêmes paramètres, vous devriez pouvoir relancer le workflow et comprendre ce qui s’est passé. C’est important en recherche, parce que les méthodes doivent être décrites clairement.

Que peut faire DCSR-LLM en pratique ?

DCSR-LLM peut faire plusieurs choses concrètes. Il peut aider une chercheuse ou un chercheur à inspecter et télécharger des modèles depuis Hugging Face, exécuter certains de ces modèles localement, comparer plusieurs modèles sur le même benchmark, transformer du texte non structuré en données structurées, et adapter un modèle pour une tâche plus spécifique.

Ces idées deviennent plus faciles à comprendre avec quelques exemples.

Pouvez-vous donner un premier exemple concret d’utilisation ?

Imaginons qu’une chercheuse ou un chercheur en sciences sociales dispose de 2 000 transcriptions d’entretiens et souhaite les organiser.

Chaque entretien est rédigé en texte libre. Pour chaque transcription, la personne souhaite extraire un petit ensemble de champs clairement définis, par exemple :

– le titre ou l’identifiant de l’entretien ;

– la date de l’entretien ;

– le lieu ;

– le nom ou le profil de la personne interrogée ;

– l’institution ou l’organisation mentionnée ;

– le thème principal abordé ;

– une courte citation justifiant l’extraction.

Un chatbot classique peut aider sur quelques entretiens, un par un. Mais cela devient difficile dès qu’il y a des milliers de textes et que l’on veut la même structure à chaque fois.

Avec DCSR-LLM, l’équipe peut définir les champs qu’elle veut, exécuter le même processus d’extraction sur l’ensemble de la collection, enregistrer les résultats dans un format structuré, puis les relire. L’IA ne remplace pas la chercheuse ou le chercheur. Mais elle peut aider à transformer une grande collection de textes en quelque chose de plus facile à examiner et à analyser.

Pouvez-vous donner un deuxième exemple concret d’utilisation ?

Imaginons qu’une équipe de recherche en biologie ou en médecine souhaite utiliser l’IA pour répondre à un ensemble de questions spécifiques à son domaine.

Avant de choisir un modèle, l’équipe veut savoir lequel fonctionne le mieux pour sa tâche. Si elle utilise seulement des chatbots de manière manuelle, la comparaison devient difficile. Une personne peut poser des questions légèrement différentes. Une autre peut utiliser une autre formulation. Les résultats deviennent alors plus difficiles à comparer de manière équitable.

Avec DCSR-LLM, l’équipe peut préparer une liste fixe de questions et exécuter la même évaluation sur plusieurs modèles. Elle peut ensuite comparer les résultats de manière plus systématique. Au lieu de dire : « ce modèle semble meilleur », elle peut dire : « nous avons testé ces modèles sur la même tâche, dans les mêmes conditions ». C’est beaucoup plus proche d’une démarche de recherche.

Pouvez-vous donner un troisième exemple concret d’utilisation ?

Imaginons qu’une chercheuse ou un chercheur dispose d’une très grande collection de textes, par exemple 10 000 articles scientifiques ou 10 000 transcriptions YouTube.

La personne peut vouloir poser des questions comme :

– Cet article parle-t-il de changement climatique, de migration ou de politique publique ?

– Cette personne parle-t-elle de l’intelligence artificielle de manière positive ou négative ?

– Ce texte mentionne-t-il un concept, un auteur ou une méthode particulière ?

– Le but principal de cet article est-il d’expliquer, de critiquer ou de comparer ?

– Cette transcription contient-elle un témoignage personnel, une opinion experte ou un argument politique ?

– Quels passages parlent d’éthique, de coût ou de risque ?

Un chatbot classique peut aider avec un article ou une transcription à la fois. Mais cela devient peu pratique lorsque la collection contient des milliers de textes.

Avec DCSR-LLM, la chercheuse ou le chercheur peut exécuter le même workflow sur l’ensemble du corpus de manière plus systématique. Au lieu de copier du texte manuellement dans un chatbot, il devient possible de traiter la collection de manière structurée et d’enregistrer les résultats pour une analyse ultérieure.

L’intérêt n’est donc pas seulement que l’IA puisse répondre à des questions. L’intérêt est qu’il devient possible de poser les mêmes questions de recherche à grande échelle, sur un vaste ensemble de textes, de manière plus organisée et reproductible.

Pouvez-vous donner un quatrième exemple concret d’utilisation ?

Imaginons qu’une équipe ait trouvé un modèle qui fonctionne assez bien, mais pas encore suffisamment bien pour son domaine. Par exemple, le modèle peut avoir de la difficulté avec le vocabulaire d’une discipline particulière, ou avec le format exact des réponses attendues dans un projet.

Dans ce cas, l’équipe peut vouloir adapter le modèle à une tâche ou à un domaine spécifique, puis mesurer si cette adaptation a réellement amélioré les résultats.

DCSR-LLM peut soutenir ce type de workflow avant/après. Une équipe peut tester le modèle d’origine, l’adapter à la tâche, puis le tester à nouveau sur le même benchmark. Cela donne une réponse plus claire qu’une simple impression du type : « la nouvelle version semble meilleure ».

Donc DCSR-LLM n’est pas principalement fait pour discuter avec un chatbot ?

Exactement. Il peut être utilisé pour dialoguer, mais ce n’est pas sa fonction principale. Sa fonction principale est de soutenir un travail structuré avec les modèles de langage : évaluation, extraction, comparaison et adaptation. C’est pourquoi il est plus utile de le considérer comme un outil de recherche que comme un simple chatbot.

Faut-il savoir programmer ?

Pas nécessairement en profondeur, mais un certain soutien technique est utile.

DCSR-LLM est un outil en ligne de commande. Cela signifie qu’il s’utilise dans un terminal, et non à travers une interface web en point-and-click. Les utilisatrices et utilisateurs n’ont donc pas besoin d’être des programmeuses ou programmeurs experts, mais ils doivent être à l’aise avec un environnement technique de base, ou travailler avec le soutien de la DCSR ou de collègues plus expérimentés techniquement.

L’important est que DCSR-LLM n’est pas réservé aux spécialistes de l’IA. Mais ce n’est pas non plus un produit grand public conçu pour un usage entièrement occasionnel.

Où DCSR-LLM peut-il être exécuté ?

Il peut fonctionner sur un ordinateur personnel pour de petites expériences. Il est aussi conçu pour fonctionner sur l’infrastructure de l’UNIL, notamment sur Curnagl et Urblauna.

C’est important, parce qu’un projet peut commencer modestement puis grandir. Une chercheuse ou un chercheur peut d’abord tester une idée sur un ordinateur portable, puis exécuter plus tard un workflow plus important sur les clusters de l’UNIL.

Pourquoi est-ce utile ?

Parce que de nombreux projets ne commencent pas avec un investissement massif. Les chercheuses et chercheurs commencent souvent avec une question simple : « Est-ce que ce modèle peut m’aider avec mon matériel ? »

Si les premiers résultats sont prometteurs, ils peuvent ensuite vouloir passer à une autre échelle : plus de documents, plus de modèles, plus de comparaisons, plus de calculs exigeants. DCSR-LLM accompagne cette montée en échelle progressive.

Quelle est l’idée principale derrière DCSR-LLM ?

L’idée principale est simple. DCSR-LLM aide les chercheuses et chercheurs à passer d’un usage informel des chatbots à une manière plus contrôlée de travailler avec l’IA. Cela signifie plus de clarté sur le modèle utilisé, l’endroit où les données sont traitées, la manière dont les résultats sont générés, et la façon dont le workflow peut être répété.

Est-ce que l’IA remplace la chercheuse ou le chercheur ?

Non. L’IA peut aider dans certaines tâches, parfois de manière très efficace. Mais les chercheuses et chercheurs doivent toujours définir la question, choisir la méthode, relire les résultats et les interpréter. DCSR-LLM est utile parce qu’il aide à organiser un travail fondé sur l’IA. Il ne supprime pas la nécessité du jugement scientifique.

Alors, qu’est-ce que DCSR-LLM en une phrase ?

DCSR-LLM est un outil pratique développé à l’UNIL, qui aide les chercheuses et chercheurs à utiliser les grands modèles de langage de manière plus concrète, plus contrôlée et plus reproductible qu’avec une simple interface de chatbot.

Liens utiles

– Dépôt : https://git.dcsr.unil.ch/Scientific-Computing/dcsr-llm

– Plus d’informations : https://wiki.unil.ch/ci/link/2266

– Contact : helpdesk@unil.ch (objet : DCSR-LLM)